Avec l’explosion des données et l’essor des architectures orientées événement, l’event sourcing s’est imposé comme une méthode incontournable. Ce paradigme permet de résoudre les défis liés à la gestion de la persistance des informations en enregistrant des événements au lieu de simplement stocker l’état actuel. En particulier, Apache Kafka, reconnu pour sa robustesse et sa scalabilité, s’est révélé être un choix privilégié pour la mise en œuvre de l’event sourcing. Cet article explore les meilleures pratiques pour tirer pleinement parti de l’event sourcing avec Kafka, afin de garantir des systèmes fiables et évolutifs.

Comprendre l’Event Sourcing et son Importance dans le Monde Moderne

L’event sourcing est un motif de conception qui se concentre sur l’enregistrement des événements qui modifient l’état d’un système. Contrairement aux approches traditionnelles où seule la dernière valeur de l’état est conservée, l’event sourcing permet de conserver chaque changement effectué sur une entité sous forme d’événements. Chaque événement est alors considéré comme un fait immuable, offrant ainsi la possibilité de reconstituer l’état à n’importe quel moment en rejouant ces événements. Ce paradigme présente plusieurs avantages significatifs :

- Auditabilité : Chaque changement est enregistré, ce qui facilite l’audit et la traçabilité des actions.

- Scalabilité : L’écriture d’événements peut être séparée de la lecture, permettant d’optimiser les performances.

- Résilience : L’application peut reconstruire son état en cas de défaillance, grâce à la persistance des événements.

Dans un contexte commercial où la prise de décision rapide est cruciale, l’event sourcing offre une flexibilité précieuse. Cependant, sa mise en œuvre nécessite des pratiques avisées pour éviter des écueils courants. Apache Kafka s’est imposé comme une solution de choix, notamment pour sa capacité à gérer un grand volume d’événements en temps réel tout en garantissant leur intégrité.

Les Fondamentaux de l’Event Sourcing

Avant de plonger dans les aspects techniques de l’implémentation, il est essentiel de clarifier quelques notions de base. L’event sourcing repose sur des événements, qui doivent être clairement définis. Chaque changement d’état dans un système, qu’il s’agisse de l’ajout d’un client ou de la modification d’une commande, doit être enregistré sous la forme d’un événement significatif. Cette approche présente plusieurs caractéristiques clés :

- Immutable : Une fois enregistrés, les événements ne peuvent être modifiés, ce qui garantit la cohérence des données.

- Chronologique : Les événements sont stockés dans l’ordre où ils se produisent, permettant ainsi une reconstitution précise de l’état.

- Évolutif : Le système peut évoluer sans nécessiter de migrations de base de données complexes, car les événements précédents « parlent » d’eux-mêmes.

En 2025, les entreprises adoptent de plus en plus cette méthode pour leur infrastructure de données. Elles constatent qu’en utilisant un système d’event sourcing avec Kafka, elles peuvent non seulement répondre aux exigences de mise à l’échelle, mais aussi gérer des volumes de données massifs avec agilité.

L’Infrastructure Idéale pour l’Event Sourcing avec Kafka

Pour réussir à implémenter l’event sourcing avec Kafka, il est crucial de concevoir une infrastructure adaptée. Lors de la création d’une architecture, plusieurs éléments doivent être pris en compte, depuis le choix des technologies jusqu’à la mise en place des bonnes pratiques.

Kafka offre une plateforme idéale pour l’event sourcing grâce à sa structure distribuée et à sa capacité à traiter des flux de données en temps réel. Cependant, il est impératif de structurer vos topics correctement. Voici quelques stratégies pour y parvenir :

| Stratégie | Avantages | Inconvénients |

|---|---|---|

| Topic unique pour tous les événements | Vue d’ensemble facile du flux d’événements | Complexité accrue lors de la recherche d’événements spécifiques |

| Topic par type d’entité | Gestion optimisée des événements par type | Peut nécessiter une gestion plus complexe lors de l’agrégation |

| Topic par entité individuelle | Suivi très granulaire des événements | Problèmes de scalabilité à long terme |

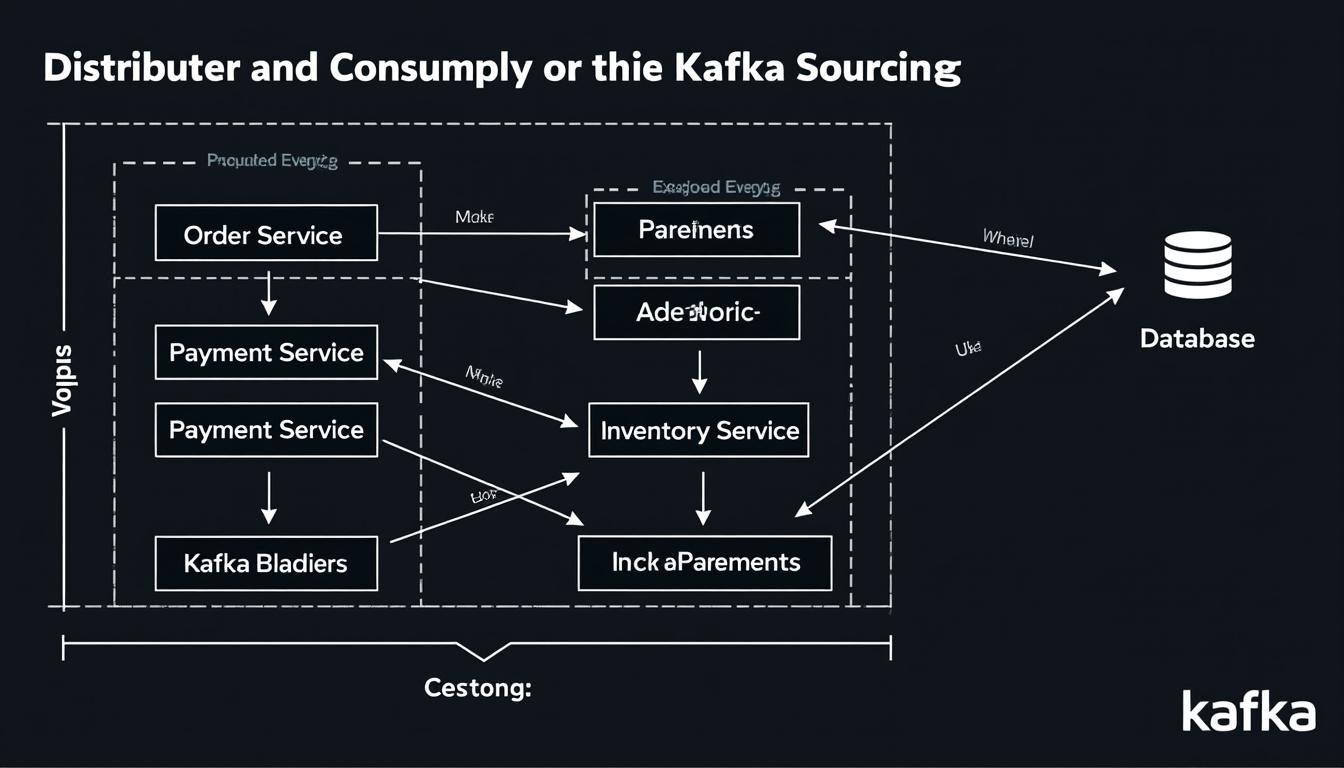

Implémentation de l’Event Sourcing avec Kafka

Lorsque vous implémentez l’event sourcing avec Kafka, le processus général peut être divisé en plusieurs étapes clés. Ces étapes garantissent une transition en douceur vers une architecture orientée événement :

- Identification des événements : Les événements doivent être définis clairement. Par exemple, pour un système de gestion des commandes, des événements comme OrderCreated et OrderCancelled doivent être spécifiés.

- Structuration des données : Chaque événement doit avoir une structure claire, généralement au format JSON, pour assurer la compréhension et l’usage futurs.

- Conception des producteurs et consommateurs : Créez des producteurs qui envoient des événements vers Kafka et des consommateurs qui réagissent aux événements selon les besoins.

- Gestion des erreurs : Prévoyez des mécanismes pour gérer les échecs de transmission ou les événements dupliqués.

Chaque étape nécessite une attention particulière et une planification adéquate pour assurer la robustesse de l’architecture mise en place. Une attention particulière doit être accordée à l’utilisation d’outils tels que Confluent, qui offrent des extensions spécifiques pour améliorer le fonctionnement de Kafka dans une architecture basée sur l’event sourcing.

Les Défis de l’Event Sourcing avec Kafka et Comment les Surmonter

Malgré ses nombreux avantages, l’event sourcing pose également des défis, surtout lorsqu’il est mis en œuvre avec une plateforme comme Kafka. Aborder ces défis de manière proactive est essentiel pour garantir le succès de votre système. Parmi les principaux défis, on trouve :

- Volume de données : Avec l’accumulation de grands volumes d’événements, la gestion du stockage et des performances peut devenir problématique.

- Reconstruction de l’état : Rejouer un grand nombre d’événements pour reconstruire l’état actuel peut être coûteux en ressources.

- Complexité de la logique métier : Les règles de gestion peuvent devenir difficiles à gérer, nécessitant des solutions robustes.

Pour surmonter ces défis, un ensemble de pratiques peut être mis en œuvre :

- Utilisation de snapshots : Au lieu de rejouer tous les événements depuis l’origine, intégrer des snapshots réguliers permet de réduire le temps de traitement.

- Partitionnement : En utilisant les partitions de Kafka à bon escient, on peut mieux gérer le flux de données et leur traitement.

- Test et validation : Mettre en place des tests automatisés pour vérifier la cohérence des états reconstruits.

Il est important de noter que même si ces défis existent, les avantages d’un système d’event sourcing bien conçu comme celui proposé par Kafka l’emportent largement.

Best Practices pour l’Event Sourcing avec Kafka

Pour garantir le succès et la viabilité à long terme de votre implémentation de l’event sourcing, il est crucial de suivre certaines bonnes pratiques. Ces règles permettent non seulement d’éviter des problèmes, mais elles optimisent également les performances et la maintenabilité de l’architecture.

Voici quelques recommendation :

- Conception orientée schéma : Utilisez des schémas de version pour gérer les changements dans vos événements. Cela facilitera le passage à de nouvelles versions de vos entités sans bouleverser l’écosystème existant.

- Idempotence : Assurez-vous que votre système puisse gérer les événements dupliqués sans impacts néfastes sur l’état final.

- Gestion des partitionnements : Attribuez les événements aux partitions en fonction de leur entité, ce qui garantit un ordre de traitement adéquat.

- Événements de compensation : En cas d’erreurs avec un événement, il est impératif de générer un nouvel événement qui annule les effets du précédent.

Ces principes faciliteront la gestion de l’event sourcing et augmenteront la résilience du système face à des conditions imprévues.

Exemples Concrets d’Application de l’Event Sourcing avec Kafka

Pour illustrer les concepts discutés, examinons quelques exemples concrets d’application de l’event sourcing avec Apache Kafka. Ces cas pratiques montrent comment diverses entreprises ont mis en œuvre cette technique pour améliorer leurs systèmes.

Dans le secteur bancaire, une institution a utilisé Kafka pour suivre les transactions des clients en temps réel en utilisant des événements de type Deposit et Withdrawal. En cas de problème avec un compte, le personnel peut rapidement retracer toutes les transactions pertinentes, facilitant ainsi le service client.

Dans un autre exemple, une entreprise de logistique a mis en place un système d’event sourcing pour suivre les modifications d’état des envois de produits. Chaque événement, qu’il s’agisse de l’acquisition, du stockage ou de la livraison d’un produit, est enregistré, permettant ainsi une traçabilité exhaustive. Cela a non seulement amélioré l’efficacité des opérations, mais a également augmenté la satisfaction client grâce à une transparence accrue.

Approfondir vos Connaissances en Event Sourcing avec Kafka

Pour aller plus loin dans la maîtrise de l’event sourcing avec Kafka, plusieurs ressources sont à votre disposition. Ces références vous permettront d’approfondir vos compétences et de mieux comprendre les nuances de cette approche.

- Documentation officielle de Kafka

- Confluent – Outils liés à Kafka

- Redpanda – Une alternative plus rapide à Kafka

- Debezium – Suivi des changements de données

En ajoutant à ces conseils, restez actif dans les communautés de développement et les forums pour échanger des idées et des solutions avec d’autres professionnels du domaine.

Questions Fréquemment Posées

Comment l’event sourcing avec Kafka peut-il améliorer la résilience de mon application ?

L’event sourcing permet à l’application de reconstruire son état à partir d’un flux d’événements, offrant ainsi une résilience face aux défaillances systèmes.

Est-il difficile de migrer un système existant vers un modèle d’event sourcing ?

Bien que cela puisse sembler complexe, une planification minutieuse et l’utilisation des bons outils peuvent rendre ce processus gérable.

Quelle est la plus grande limitation de l’event sourcing ?

La principale limitation réside dans la gestion des volumes élevés de données, car les événements s’accumulent rapidement. L’utilisation de snapshots aide à atténuer ce problème.

Comment l’event sourcing se compare-t-il à une approche traditionnelle basée sur une base de données relationnelle ?

L’event sourcing se concentre sur la persistance des événements et offre une flexibilité et une auditabilité nettement supérieures.

ProInfo Services est webmag contributif qui est dédié aux professionnels du B2B & B2C et leurs entreprises de tous les secteurs. Vous pourrez comme cela vous informer sur des articles, que cela soit par exemple sur les travaux de construction et rénovation, les entreprises dédiées aux réceptions et séminaires ou sur le coaching et développement professionnel …

ProInfo Services est webmag contributif qui est dédié aux professionnels du B2B & B2C et leurs entreprises de tous les secteurs. Vous pourrez comme cela vous informer sur des articles, que cela soit par exemple sur les travaux de construction et rénovation, les entreprises dédiées aux réceptions et séminaires ou sur le coaching et développement professionnel …